Le frodi di identità sintetiche, potenziate dall’IA generativa e dalle tecnologie deepfake, sono in rapida crescita, consentendo attacchi su larga scala e difficili da rilevare. Le organizzazioni sono di fronte ad una delle minacce più urgenti da gestire.

Scenario

Dati reali e fabbricati dai cybercriminali sono utilizzati per creare nuove “persone/identità”, spesso arricchite da immagini generate dall’IA, documenti e schemi comportamentali Inoltre, strumenti come le GAN (Generative Adversial Network – Reti Generative Adversariali), i grandi modelli linguistici (LLM – Large Language Model) e i motori di sintesi testo-immagine permettono ai truffatori di creare false identità, del tutto credibili, che possono passare inosservati attraverso molti KYC (Know Your Customer) e sistemi di verifica dell’identità esistenti. Ma vediamo in dettaglio di che si tratta.

Cosa rende così pericoloso il furto d’identità sintetico

Siamo di fronte ad un sofisticato tipo di frode che sta costando alle organizzazioni miliardi di dollari ogni anno, consentendo ai cybercriminali di: infiltrarsi nei sistemi; ottenere accessi non autorizzati; commettere crimini finanziari; sfruttare piattaforme digitali per attività illecite. Di fatto, i cybercriminali combinano dati autentici — come numeri di previdenza sociale, indirizzi o numeri di telefono — con nomi o date di nascita fittizie per creare identità in grado di superare molti controlli di verifica tradizionali, rendendole estremamente difficile da segnalare.

Le identità sintetiche, dopo essere state create, vengono impiegate per l’apertura di conti bancari, la richiesta di prodotti finanziari e la costruzione di profili creditizi apparentemente legittimi. Tali profili operano in modo persistente e mimetico all’interno dei sistemi finanziari, simulando il comportamento di clienti autentici per periodi prolungati. Al momento opportuno, gli attori fraudolenti effettuano una rapida esfiltrazione di fondi, causando perdite significative alle istituzioni coinvolte, rendendo la frode da identità sintetica una delle minacce più redditizie e difficili da intercettare nel panorama finanziario globale. Secondo la Federal Reserve, questa tipologia di crimine rappresenta il segmento a più rapida crescita nell’ambito delle frodi finanziarie.

La tecnologia dietro la frode d’identità sintetica e lo sfruttamento delle lacune di sicurezza

Di seguito una panoramica delle varie tecniche di frode generate da identità sintetiche.

- Volti generati dall’IA e persone false – Piattaforme di IA generativa come StyleGAN2 e Midjourney possono generare volti umani fotorealistici che non appartengono a nessun individuo reale e che sono utilizzati in account social media, curriculum, passaporti falsi o videochiamate in grado di bypassare i sistemi di riconoscimento facciale, portando ad accessi non autorizzati in ambienti digitali e fisici.

- Impersonificazione vocale e video deepfake – Strumenti avanzati di sintesi vocale – quali Resemble AI ed ElevenLabs – permettono agli attaccanti di creare voci clonate che possono impersonare CEO, funzionari bancari o rappresentanti governativi. Inoltre, deepfake a corpo intero possono essere generati, utilizzando strumenti di editing video e animazione basati su IA rendendo vulnerabili l’autenticazione vocale e i sistemi di sicurezza basati su biometria, se non combinati con meccanismi di verifica contestuale o comportamentale.

- Documentazione sintetica e falsificazione biometrica – I threat actor, sfruttando avanzati strumenti di intelligenza artificiale, sono in grado di generare documenti d’identità sintetici—tra cui passaporti, patenti di guida e report creditizi—caratterizzati da un elevato livello di sofisticazione e verosimiglianza. Tali artefatti digitali sono utilizzati per l’apertura di conti bancari, la richiesta di prodotti finanziari e l’accesso a servizi sensibili. È doveroso evidenziare che i sistemi di verifica documentale – che si affidano esclusivamente a processi di OCR superficiale o all’analisi di segnali visivi – risultano particolarmente vulnerabili a tali manipolazioni: in assenza di tecniche di watermarking forense o di validazione approfondita dei metadati, le identità sintetiche possono essere erroneamente riconosciute come autentiche, compromettendo l’efficacia dei controlli.

- Chatbot AI e botnet simili a umani – I cybercriminalisfruttano reti di identità sintetiche orchestrate – tramite grandi modelli linguistici e avatar generativi – impiegandole come bot avanzati o utenti apocrifi per manipolare flussi audio online, compromettere servizi di customer care o infiltrarsi in piattaforme digitali. Di fatto, i modelli di testo e di comportamento sociale generati dall’IA risultano pressoché indistinguibili dalle vere interazioni, soprattutto in assenza di sistemi di profilazione contestuale in tempo reale. Purtroppo, le evidenze più recenti dimostrano che i meccanismi di sicurezza tradizionali – basati su controlli superficiali di immagini, voce o documentazione – risultano facilmente eludibili: l’IA è ormai in grado di generare artefatti sintetici altamente credibili, esponendo organizzazioni e pubbliche amministrazioni a rischi significativi, qualora non vengano adottate strategie di rilevamento adattivo delle anomalie e processi di verifica multilivello.

L’impatto per settore: dove la frode colpisce di più

La frode d’identità sintetica sta impattando i vari ecosistemi della nostra società, spesso con conseguenze devastanti. DI seguito uno schema dei settori più colpiti, i vettori di minaccia rilevanti e le implicazioni per la sicurezza.

Minacce scaturite da identità sintetiche per settore

| Settore | Vettore di minaccia | Implicazioni per la sicurezza | Azioni consigliate |

| Finanza | Richieste di prestiti/credito fraudolente, app di pagamento, autorizzazioni | Perdite finanziarie, danni reputazionali, violazioni AML (Anti Money Laundering – Antiriciclaggio) | Le banche devono andare oltre i controlli KYC statici e garantire un monitoraggio continuo delle frodi, utilizzando il machine learning |

| E-Commerce | Acquirenti sintetici, recensioni false | Manipolazione dei prodotti, modelli di frode demand falsi | Necessità di autenticazione multi-livello e punteggi di frode basati su anomalie |

| Sanità | Pazienti falsi e richieste di risarcimento | Frodi assicurative, esposizione di dati | I sistemi EHR (Electronic Health Record) devono rilevare anomalie nei metadati e modelli di accesso insoliti |

| Telecomunicazioni | Attacchi SIM swap con ID sintetici | Dirottamento account mobili, violazioni della privacy | Rilevamento frodi basato su IA, prevenzione SIM swap e verifica abbonati basata su biometria |

| Pubblica Amministrazione | Appalti falsi e registrazione servizi cittadini | Erosione della fiducia, perdite di bilancio, servizi compromessi | I governi devono utilizzare verifica ID digitale collegata a registri nazionali e validazione biometrica |

Il settore dei servizi finanziari rimane il più preso di mira, poiché le carte d’identità sintetiche vengono utilizzate – come già evidenziato – per aprire conti bancari, richiedere prestiti e gestire schemi di riciclaggio di denaro.

Negli ultimi anni, in Medio Oriente, le frodi negli appalti pubblici e nel settore bancario sono aumentate drasticamente, spingendo i regolatori a sospendere l’onboarding remoto e a inasprire gli standard di verifica biometrica.

Perché i controlli tradizionali falliscono contro le identità sintetiche

Di seguito le principali cause per cui i controlli tradizionali falliscono

| Tipo di controllo | Perché fallisce contro le identità sintetiche |

| Autenticazione basata su password | Le identità generate dall’IA sono progettate specificamente per sfruttare le vulnerabilità dei sistemi di autenticazione, risultando ottimizzate per attacchi di credential stuffing e capaci di eludere i controlli basati su credenziali statiche. |

| Verifica biometrica statica | Volti falsificati, voci clonate e pattern di andatura alterati ingannano la biometria semplice. |

| Device fingerprinting | Gli attori fraudolenti oggi impiegano dispositivi virtualizzati ed emulatori dotati di firme digitali clonate, eludendo così i meccanismi di device fingerprinting tradizionali e rendendo più complessa l’identificazione di accessi sospetti. |

| Verifica documenti | Le soluzioni basate su GAN sono ora in grado di produrre documenti d’identità sintetici estremamente realistici, caratterizzati da elementi sofisticati quali codici a barre, ombreggiature e segni di usura, rendendo tali artefatti difficilmente distinguibili dai documenti autentici attraverso i tradizionali sistemi di Verifica. |

Il problema fondamentale è determinato dal fatto che le frodi sintetiche mancano di una “vittima”; quindi, i tradizionali strumenti di rilevamento violazioni e allerta non registrano un’anomalia fino a quando non si verificano perdite significative.

Controlli di sicurezza che funzionano ancora (e quelli emergenti)

Per contrastare le identità sintetiche, la cybersecurity si sta orientando verso architetture di sicurezza adattive e stratificate che integrano l’IA con approcci zero-trust e analisi comportamentale. Vediamo di seguito di che si tratta.

| Misura di sicurezza | Funzione |

| Biometria comportamentale | Garantisce l’analisi continua dei pattern di digitazione, delle modalità di scorrimento e delle interazioni di navigazione, al fine di distinguere utenti autentici da identità sintetiche generate artificialmente. |

| Rilevamento della vitalità + rilevamento deepfake | Consente di verificare la presenza effettiva di un soggetto umano e di identificare input video manipolati, segnalando tentativi di spoofing o impersonificazione digitale. |

| Autenticazione continua | L’identità viene rivalutata durante l’intero ciclo di vita della sessione, utilizzando comportamento, posizione, ecc. |

| Rilevamento media sintetici (Watermarking) | Identifica contenuti generati da GAN attraverso anomalie dei pixel o watermarking AI. |

| Analisi dei grafi di identità | Confronta profili utente, comportamenti transazionali e metadati tra piattaforme. |

| Integrazione threat intelligence | Utilizza segnali in tempo reale provenienti da database di frodi e feed cyber, al fine di identificare e segnalare accessi ad alto rischio. |

| AI red-teaming | Consiste nella simulazione di scenari di frode basati su identità sintetiche, al fine di testare e valutare la resilienza dell’organizzazione rispetto a queste minacce. |

Fornitori di cybersecurity come Darktrace, BioCatch e Microsoft Security Copilot stanno ora integrando tali difese nei motori di rilevamento delle frodi.

Integrazione della sicurezza: ripensare la fiducia digitale

A fronte dello scenario sopra descritto, è fondamentale per le organizzazioni evolvere le proprie strategie di sicurezza. Ovvero: la sicurezza deve ora andare oltre le password e la biometria tradizionale e considerare controlli misti, consapevoli del contesto e basati sull’IA. Di, seguito alcune strategie di sicurezza che è opportuno considerare.

- Biometria comportamentale e autenticazione continua – Le organizzazioni, anziché basarsi su credenziali statiche o su verifiche dell’identità eseguite una sola volta, devono implementare sistemi di monitoraggio continuo dei comportamenti degli utenti. Tale approccio prevede l’analisi costante di pattern di digitazione, dati di geolocalizzazione, modalità di interazione con i dispositivi e tempistiche d’uso, al fine di identificare tempestivamente eventuali anomalie comportamentali indicative di attività fraudolente o di impersonificazione.

- Motori di rilevamento deepfake – Le organizzazioni possono implementare strumenti di rilevamento deepfake, come il Video Authenticator o il Deepware Scanner di Microsoft, per valutare in tempo reale l’autenticità dei contenuti inviati.

- Protocolli Executive MFA – Si tratta di protocolli che prevedono che le approvazioni sensibili – quali trasferimenti di fondi o modifiche alle policy – siano sottoposte a livelli aggiuntivi di autenticazione che possono includere l’utilizzo di chiavi hardware dedicate, challenge biometriche avanzate, una validazione secondaria effettuata da un ufficio autorizzato, al fine di garantire la massima sicurezza nelle operazioni critiche.

- Rilevamento delle anomalie e modelli di minaccia IA – Le architetture zero-trust, potenziate da modelli di minaccia basati su intelligenza artificiale, consentono il rilevamento di attività impreviste—come accessi da posizioni anomale o schemi di interazione atipici—e sono in grado di attivare risposte automatiche quali l’accesso condizionato o la richiesta di una verifica umana

- Prova d’identità digitale –Le nuove soluzioni di verifica dell’identità integrano il machine learning per analizzare l’autenticità dei documenti d’identità, il comportamento facciale e la validazione cross-database.

Sviluppi legali e normativi: panoramica globale

I governi, a diverse latitudini, stanno cercando di varare normative o intraprendere iniziative atte a contenere le minacce delle identità sintetiche.

Legge sull’IA dell’Unione Europea –Impone trasparenza nell’uso dell’IA, specialmente per i deepfake, e richiede watermarking e tracciabilità nei media sintetici. Enfatizza inoltre applicazioni di IA ad alto rischio come l’identificazione biometrica e la finanza.

Regno Unito – Online Safety Act) –Criminalizza la creazione e la diffusione di deepfake malevoli e impone alle piattaforme di rimuovere contenuti sintetici utilizzati per frodi.

India – Bozza di Digital India Act Include disposizioni per l’uso improprio dell’IA, il furto d’identità e la protezione dei dati. L’obiettivo è regolamentare i contenuti generati dall’IA, prevedendo responsabilità penali in caso di utilizzo illecito o fraudolento delle tecnologie di intelligenza artificiale.

Arabia Saudita –LaSAMA (Saudi Central Bank) ha sospeso le aperture di conti bancari remoti nel 2023 dopo aver scoperto oltre 4,8 milioni di identità sospette e ha introdotto sistemi di onboarding più rigorosi, riverifica biometrica e integrazione umana nel circuito. La NCA (National Cybersecurity Authority) ha lanciato il Quadro di Governance dell’IA e gli standard etici sull’IA. Impone inoltre il monitoraggio in tempo reale delle frodi nelle banche, nei sistemi fintech e di governo elettronico.

Canada – Disegno di legge C-63 – Tale disegno penalizza l’abuso del deepfake ai sensi dell’Online Harms Act. Amplia inoltre i poteri delle forze dell’ordine per tracciare attività fraudolente generate dall’IA

Trend principali delle identità sintetiche 2025-2026

Secondo i dati del report “Identity Fraud Report 2025–2026” di Sumsub – scaturito dall’analisi di oltre 4 milioni di tentativi di frode tra il 2024 e il 2025 – attualmente si sta assistendo ad una trasformazione strutturale nota come “sophistication shift”, che segna il passaggio da attacchi opportunistici a operazioni fraudolente di natura professionale e coordinata. Tale cambiamento comporta una crescente complessità delle tecniche impiegate, una maggiore organizzazione degli attori coinvolti e un impatto più significativo sui sistemi finanziari e digitali. Vediamo di seguito di che si tratta.

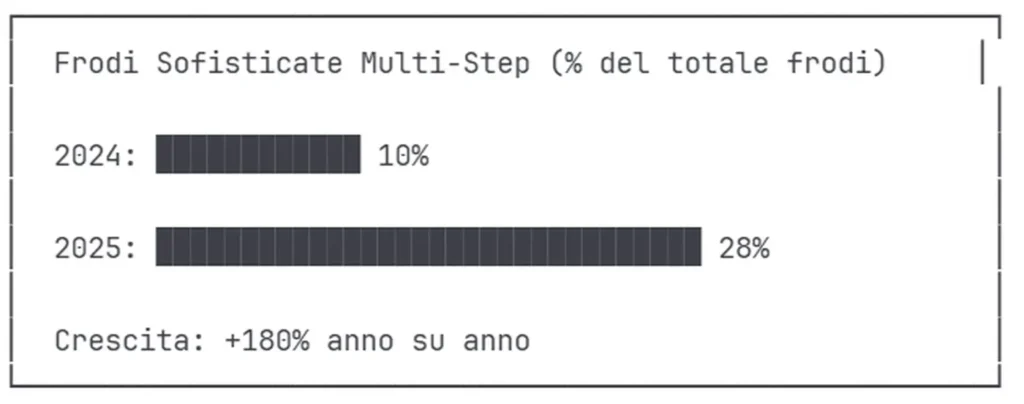

Evoluzione delle frodi sofisticate multi-step – Dal report di Sumsub si evince che le frodi sofisticate multi-step sono aumentate del 180% anno su anno, passando dal 10% nel 2024 al 28% nel 2025 di tutte le frodi di identità. Paradossalmente, mentre il tasso complessivo di frode è diminuito dal 2,6% al 2,2%, la complessità e l’impatto degli attacchi sono cresciuti significativamente, con il 40% delle aziende e il 52% degli utenti finali che hanno riportato di essere stati vittime di frode nel 2025.

Previsioni di crescita delle minacce nel 2026 – L’elemento più preoccupante che rivela il report di Sumsub è l’emergenza degli agenti di frode basati su IA autonomi, ovvero, sistemi in grado di eseguire intere operazioni fraudolente con minima supervisione umana. Tali agenti combinano IA generativa, framework di automazione e apprendimento per rinforzo, permettendo loro di: creare identità sintetiche; generare documenti falsi su richiesta; interagire in tempo reale con i sistemi di verifica; apprendere dai tentativi falliti per raffinare le strategie future.

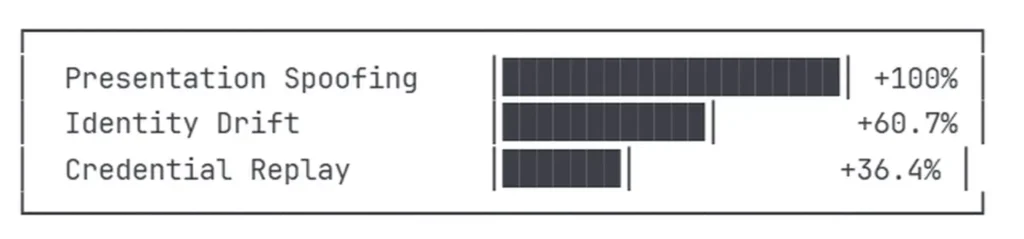

AU10TIX, leader globale nella verifica dell’identità e nella gestione del rischio, ha identificato il 2025 come l’anno dell’”inganno automatizzato”, prevedendo per il 2026 un aumento de: il 100% dei casi di presentation spoofing di presentazione; il 60,7% nell’identity drift; il 36,4% nel credential replay. Inoltre, gli analisti prevedono che questi agenti diventeranno mainstream entro 18 mesi, con flotte coordinate capaci di condurre attacchi multi-step ad alta velocità e su vasta scala.

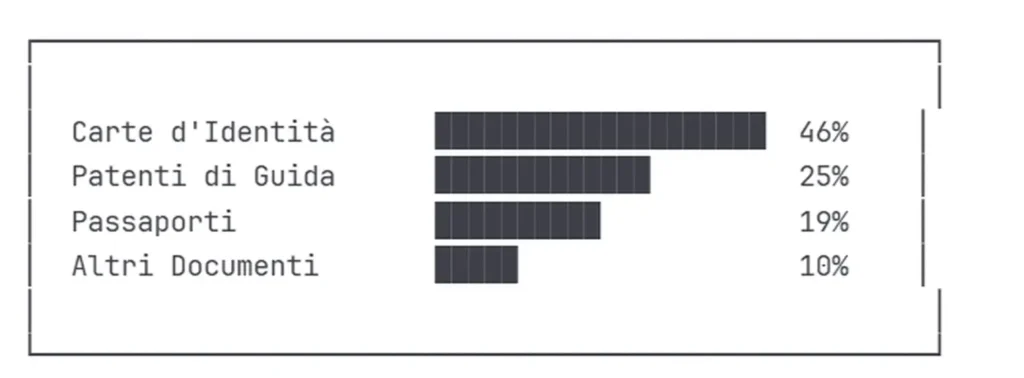

Documenti contraffatti più comuni (2025) – Un trend particolarmente rilevante è rappresentato dalla falsificazione di documenti assistita dall’IA, fenomeno emerso nel 2025 con un’incidenza pari al 2% di tutti i documenti falsi identificati, rispetto allo 0% registrato nel 2024. Tale crescita è stata alimentata dall’utilizzo di strumenti avanzati come ChatGPT, Grok e Gemini.

I documenti contraffatti più comuni risultano essere le carte d’identità nazionali (46%), le patenti di guida (25%) e i passaporti (19%), con variazioni regionali significative: il 60% dei documenti fraudolenti nell’area Asia-Pacifico sono carte d’identità nazionali, mentre nelle Americhe il 37% sono patenti false.

Inoltre, risulta che le identità sintetiche costituiscono il 21% degli schemi di frode first-party, in cui il soggetto che si sottopone alla verifica è lo stesso attore fraudolento. Tali identità risultano particolarmente efficaci poiché combinano numeri di previdenza sociale autentici con nomi, indirizzi e credenziali inventati, generando profili in grado di compromettere il credito delle vittime per anni, senza essere rilevati dai sistemi di controllo.

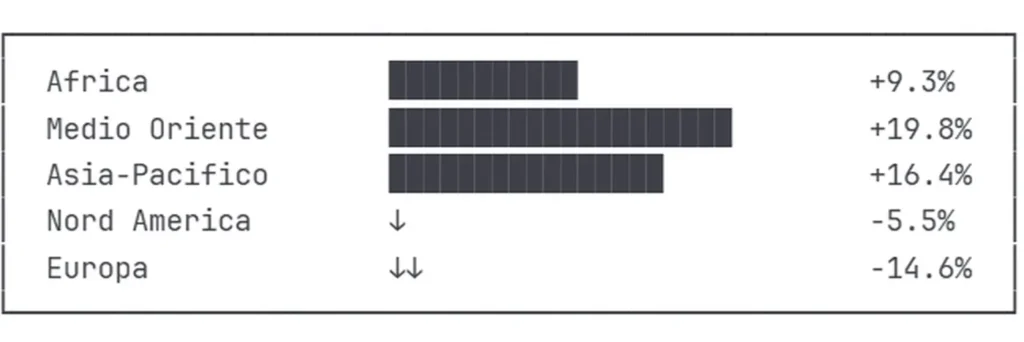

Variazione dei tassi di frode per area geografica (2025) – Dal punto di vista geografico, evidenzia una significativa redistribuzione del rischio a livello globale. In particolare, l’Europa e il Nord America hanno registrato una riduzione dei tassi di frode, rispettivamente del 14,6% e del 5,5%, attribuibile alla maturità degli ecosistemi normativi e all’adozione di framework di sicurezza più avanzati. Tuttavia, in queste regioni si osserva una crescente sofisticazione delle tecniche di attacco. Al contrario, l’area Asia-Pacifico ha sperimentato un incremento del 16,4% nei tassi di frode, il Medio Oriente del 19,8% e l’Africa del 9,3%, riflettendo una maggiore esposizione dovuta a contesti regolatori meno consolidati e a una rapida evoluzione delle minacce.

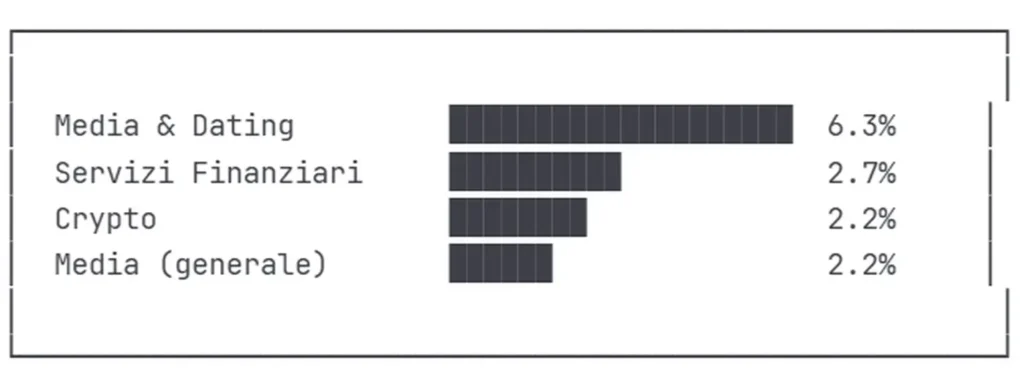

Settori più colpiti da frodi (2025) – I settori più colpiti nel 2025 sono stati media online e dating (6,3%), servizi finanziari (2,7%), crypto (2,2%), con il 67% delle frodi su piattaforme crypto che avviene già durante la fase di onboarding, sfruttando bonus di registrazione e meccanismi di referral attraverso KYC deboli.

Trend 2026 ed efficacia sistemi di early-warning – Guardando al 2026, il 75% degli intervistati del report di Sumsub prevede che le frodi saranno sempre più guidate dall’intelligenza artificiale, con l’emergere di attacchi di social engineering potenziati dall’IA, voice spoofing e impersonificazione su larga scala. Un ulteriore rischio emergente è rappresentato dalla minaccia quantistica, che potrebbe compromettere le fondamenta matematiche degli attuali standard crittografici.

Per contrastare questa evoluzione, le organizzazioni stanno abbandonando i controlli statici di verifica dell’identità a favore di architetture di sicurezza adattive e stratificate che integrano autenticazione continua, analisi comportamentale, biometria comportamentale, rilevamento deepfake, intelligence sulle minacce in tempo reale e sistemi di early-warning capaci di identificare anomalie comportamentali con una correlazione del 97,5% dei tentativi di frode confermati.

Gartner prevede che entro il 2026, il 30% delle imprese non considererà più affidabili le soluzioni standalone di verifica dell’identità e autenticazione, segnalando un cambiamento di paradigma verso ecosistemi unificati che fondono in un’unica funzione di intelligence prevenzione delle frodi, gestione del rischio e compliance.

Strategie di prevenzione delle frodi di identità sintetica nel 2026

Nel 2026, la prevenzione delle frodi di identità sintetica richiederà l’adozione architetture di sicurezza adattive e stratificate e l’implementazione di framework di verifica multi-livello che integrino validazione documentale, analisi comportamentale e intelligence continua. Ovvero:

1. Hardening del processo di onboarding – L’onboarding rappresenta il primo perimetro difensivo critico e deve essere progettato secondo principi di defense-in-depth piuttosto che ottimizzato esclusivamente per la frizione utente. L’implementazione deve prevedere:

- Orchestrazione di fonti authoritative data: integrazione con registri governativi, bureaux creditizi e database di identità verificate per la cross-validazione dei dati anagrafici.

- Document verification avanzata: analisi forense dei documenti che combina rilevamento di anomalie pixel-level, verifica delle caratteristiche di sicurezza (ologrammi, microprint, UV patterns) e validazione della coerenza metadata (EXIF, timestamp, geolocalizzazione)

- Identity proofing multi-fattore: correlazione tra attributi dichiarati e tracce digitali esistenti per verificare la consistenza temporale dell’identità.

2. Compliance a standard di identità digitale – L’adozione di framework normativi consolidati – quali NIST Special Publication 800-63 (Digital Identity Guidelines) – garantisce l’allineamento con le best practice di settore in termini di:

- Identity Assurance Levels (IAL): calibrazione del rigore di verifica in base al profilo di rischio del servizio.

- Authenticator Assurance Levels (AAL): selezione di meccanismi di autenticazione proporzionati alla sensibilità delle transazioni.

- Federation Assurance Levels (FAL): gestione sicura delle asserzioni di identità in contesti federati.

È doveroso evidenziare che gli standard NIST promuovono l’adozione di controlli di sicurezza risk-based, autenticazione multi-fattore, tecniche di liveness detection e protezione contro attacchi di presentation attack (deepfake, replay attack, synthetic media injection).

3. Correlazione multimodale: documenti, dispositivi e comportamento – La validazione documentale isolata è insufficiente contro identità sintetiche sofisticate. Ne consegue che è necessario implementare una correlazione multimodale che integri:

- Device intelligence: fingerprinting avanzato che analizza configurazione hardware, sistema operativo, browser fingerprint, TLS/SSL fingerprint, caratteristiche di rete e cronologia dispositivo per identificare anomalie (device emulation, virtual machines, device farms).

- Behavioral biometrics: analisi continua dei pattern comportamentali durante la sessione, inclusi keystroke dynamics, mouse movement patterns, touch pressure/velocity, navigation patterns e session timing.

- Contextual analysis: valutazione della coerenza contestuale tra localizzazione geografica, timezone, language settings, IP reputation e attributi dichiarati.

Tali layer permettono di identificare indicatori di sintesi, quali: inconsistenze tra device history e età dichiarata, pattern comportamentali non-umani o device multiplexing tipico delle fraud rings.

4. Biometria con liveness detection avanzata – I sistemi biometrici devono incorporare meccanismi di Presentation Attack Detection (PAD) di livello ISO/IEC 30107 per contrastare:

- Spoofing fisico: maschere 3D-printed, protesi facciali, fotografie ad alta risoluzione.

- Spoofing digitale: deepfake video injection, replay attacks, synthetic face generation (GANs, diffusion models).

- Spoofing ibrido: dispositivi AR/VR che sovrappongono identità sintetiche a soggetti reali.

Le tecniche PAD più efficaci combinano:

- Liveness attiva (challenge-response con movimenti randomizzati).

- Liveness passiva (analisi di texture cutanea, micro-movimenti involontari, riflessi oculari, consistenza illuminazione) con modelli di deep learning addestrati su dataset adversarial.

5. AI-Powered fraud detection e graph analytics – L’implementazione di motori di fraud detection, basati su machine learning, permette l’identificazione di pattern latenti non rilevabili da regole deterministiche. Si tratta di strumenti di:

- Anomaly detection: modelli non supervisionati – i.e. Isolation Forest, Autoencoders, One-Class SVM – che identificano deviazioni statistiche rispetto ai profili legittimi.

- Graph analytics: prevede la rappresentazione delle entità—i.e. utenti, dispositivi, indirizzi, numeri di telefono e carte—sotto forma di grafi relazionali, al fine di identificare componenti connessi sospetti, quali fraud rings, reti di identità sintetiche e account mule cluster

- Ensemble Models: combinazione di classificatori eterogenei – i.e. Random Forest, Gradient Boosting, Neural Networks – per massimizzare recall su identità sintetiche riducendo false positive. I sistemi più avanzati incorporano Explainable AI (XAI) per garantire interpretabilità delle decisioni e conformità normativa (GDPR, AI Act).

6. Autenticazione continua e monitoraggio post-onboarding – Le identità sintetiche adottano strategie di “seasoning” (i.e. comportamento dormiente iniziale seguito da monetizzazione aggressiva), ne consegue che è imperativo implementare strategie di:

- Continuous authentication: re-valutazione dinamica del trust score durante il lifecycle basata su behavioral analytics, transaction patterns e contextual signals.

- Event-driven risk scoring: trigger automatici su eventi ad alto rischio (cambio credenziali, nuovo device, spike transazionale, modifica dati sensibili).

- Drift detection: identificazione di cambiamenti statisticamente significativi nei pattern comportamentali che indicano account takeover o identity drift.

7. Threat intelligence sharing e industry collaboration – delle strategie di prevenzione delle frodi è direttamente correlata al livello di visibilità e condivisione delle informazioni sulle minacce emergenti tra le organizzazioni. In quest’ottica, le iniziative collaborative risultano fondamentali e possono includere:

- Partecipazione a ISACs (Information Sharing and Analysis Centers): condivisione anonimizzata di IoCs (Indicators of Compromise), TTPs (Tactics, Techniques, Procedures) e fraud patterns.

- Consortium database: accesso a watchlist condivise di entità fraudolente (email, phone numbers, device IDs, SSNs compromessi).

- Feed di minacce in tempo reale: integrazione di intelligence esterna su campagne di frode attive, toolkits disponibili nel dark web, zero-day exploits.

8. Sviluppo delle capacità e organizational readiness – La resilienza organizzativa richiede investimenti mirati sia in capitale umano che in tecnologia, attraverso:

- Formazione specialistica: programmi di upskilling per analisti antifrode sulle tecniche di costruzione di identità sintetiche, rilevamento di contenuti generati dall’IA e gestione di frodi persistenti avanzate).

- Runbook operativi: sviluppo di playbook documentati per l’escalation decisionale, la risposta agli incidenti e la remediation degli account con SLA definiti.

- Red teaming: simulazioni periodiche di attacchi di identità sintetiche per validare l’efficacia dei controlli e per identificare gap di detection

9. Comunicazione al cliente e trasparenza- La frizione aggiuntiva introdotta dai controlli di sicurezza deve essere controbilanciata da una strategia di trasparenza proattiva, articolata su più livelli, ovvero:

- Layered disclosure: implementazione di una comunicazione graduale e contestualizzata delle motivazioni che giustificano i controlli supplementari, calibrata in funzione del profilo utente e del rischio associato.

- Educational content: produzione e distribuzione di risorse formative che illustrano i rischi correlati alle identità sintetiche e il valore aggiunto dei controlli di sicurezza adottati per la protezione dell’utente.

- Meccanismi di feedback: predisposizione di canali dedicati per la gestione e la risoluzione di false positive, nonché per l’escalation di casi legittimi erroneamente bloccati, al fine di garantire un’esperienza utente trasparente e reattiva.

Conclusione: dalla reattività alla resilienza sistemica

La lotta contro le frodi da identità sintetiche segna un punto di svolta nella cybersecurity contemporanea. Inoltre, l’emergenza di agenti di frode autonomi basati su IA e la crescente sofisticazione degli attacchi multi-step hanno reso obsoleti i modelli tradizionali basati su controlli puntuali, richiedendo una trasformazione che ridefinisca il ruolo delle organizzazioni da bersagli passivi a guardiani attivi dell’identità digitale.

Tale cambio di paradigma richiede l’abbandono della logica del checkpoint statico per abbracciare un modello di continuous identity assurance, dove ogni interazione rappresenta un’opportunità di validazione incrementale. Ovvero, le organizzazioni devono evolvere da vittime reattive a custodi proattivi capaci di anticipare i vettori di attacco emergenti e contribuire alla sicurezza collettiva attraverso la condivisione di threat intelligence.

Inoltre, il valore strategico dell’adozione di motori di fraud detection – basati sull’IA – risiede all’interno di un cognitive defense mesh che operi autonomamente, mantenendo la governance umana per decisioni ad alto impatto, oltre a garantire l’interpretabilità per la compliance e la fiducia degli stakeholder.

Ancora, la resilienza collettiva richiede un modello di co-petizione strategica, ovvero: nessuna organizzazione possiede visibilità completa sulle minacce cross-organizational. Pertanto, gli Information Sharing and Analysis Centers (ISACs), i federated learning frameworks, gli standard comuni di identity verification e public-private partnerships sono essenziali per neutralizzare le fraud-as-a-service operations e ridurre le superfici di attacco.

Infine, il futuro della prevenzione trascende la logica binaria accept/reject per abbracciare un paradigma di calibrazione continua del rischio. Ovvero, l’identity intelligence diventa un abilitatore di business che permette di ottimizzare i conversion rate, di personalizzare l’esperienza utente, di espandere in mercati ad alto rischio con controlli granulari, oltre a ridurre i costi operativi, bilanciando protezione ed esperienza cliente attraverso strategie di adaptive friction.

È doveroso evidenziare che la tecnologia, per quanto essenziale, non è sufficiente. La resilienza sistemica richiede investimento nella capacità organizzativa: upskilling continuo, integrazione cross-funzionale, incident preparedness e trasformazione culturale da risk-averse a risk-intelligent. Inoltre, la protezione contro le identità sintetiche è una responsabilità condivisa tra product teams, data scientists, executive leadership e board of directors.

Si tratta di costruire ecosistemi di identità digitale intrinsecamente robusti, basati su architetture zero-trust, standard interoperabili e credenziali verificabili, in grado di creare esperienze digitali sicure, inclusive ed efficienti, oltre a promuovere l’innovazione e crescita economica. DI fatto, la posta in gioco è il futuro stesso dell’identità digitale, quali fondamento dell’economia e della società digitale.